前言

通过Stable Diffusion,可以针对于图片进行高清重绘,而且还可以转换人物图片风格,例如可以将二次元的动漫人物转换为真实系的三次元人物。也可以将真实风格内容转换为动漫风格。

今天就来介绍下常规的人物风格转绘及高清重绘的。

方法步骤

第一步 图片处理

由于图片转绘的本质是通过AI软件基于某个模型重新绘制图片,需要对原图片尺寸做一定处理,这样转绘的效果更好。

目前很多模型是基于512*512 或 768&768 这类分辨率组合来训练,如果想要出图是更稳定,则尽量保证原图是这些参数的倍数,例如1024*768。

另外如果图片中有Logo或文字,也最好PS预处理下,处理不用很仔细,后续AI重绘时会把瑕疵掩盖住。

第二步 Stable Diffusion模型选择

需要根据想要的图片风格,确定下SD大模型,例如如果是动漫风格转真实风格,则可以找真实风格的大模型,如果不确定各模型的效果,可以通过SD中的X/Y/Z脚本进行对比跑图,确定合适的模型。

第三步 Stable Diffusion文生图或图生图

需要根据图片转绘目前有两种方式,一种是文生图方式,另一种则是图生图方法。

文生图,效果上更侧重于通过提示词描述信息来根据大模型风格生成图片,风格的转换更明显

图生图,效果上会更接近于原图画风,风格转换的灵活性会比文生图小。

以上两种方法的基础步骤都是一样的:

1)反推提示词

将原图片通过SD的Tager反推工具进行反推提示词。并复制提示词到文生图界面,并添加增加画质的基础提示词和反向提示词,如果是动漫风格转换为真实系,则可以额外追加真实系关键词,例如“realistic,reality”。

(注意:Tager 反推的提示词不用过多,此时可以调整阈值来降低词汇量,并适当调整一些可能影响出图或识别错误的提示词,例如男孩识别为女孩)

2)添加ControlNet控制

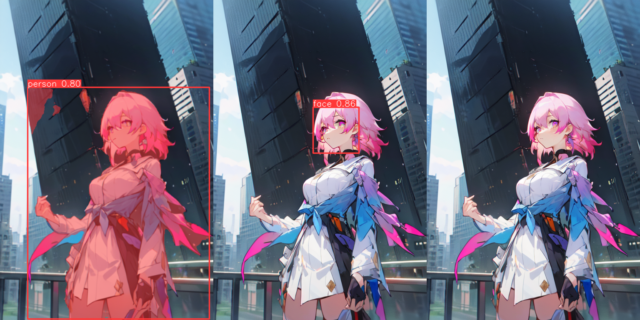

需要将原图放到ControlNet插件中,使用Tile和Lineart方法进行处理。

其中Tile选择tile_resample预处理,并再Control Mode中选择ControlNet优先,权重为1。

而Lineart则根据情况,可以调整权重为0.5-1之间,同时也可以将Lineart替换为Cany方法。

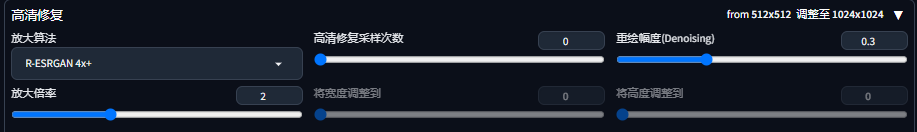

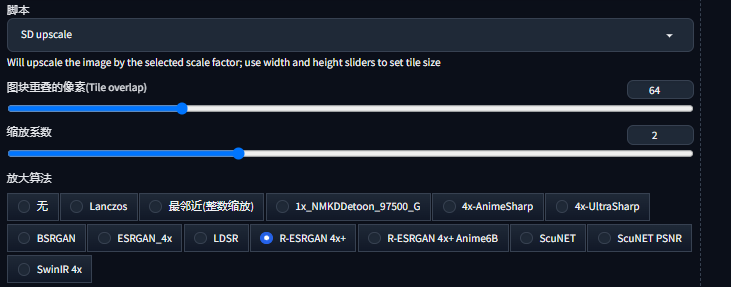

3)高清放大

如果需要图片输出高清图,则在文生图中可以使用高清修复方式放大。

如果在图生图中,则可以使用SD Upscale脚本来放大图片。

4)其他参数

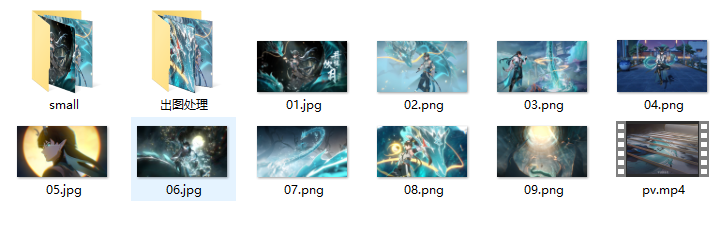

如果脸部或手部容易出问题,可以使用ADetailer插件来处理脸部和手部细节。

同时控制重绘幅度来调整图片的重绘强度。 只是基础的风格转换的话,建议0.3-0.5之间。

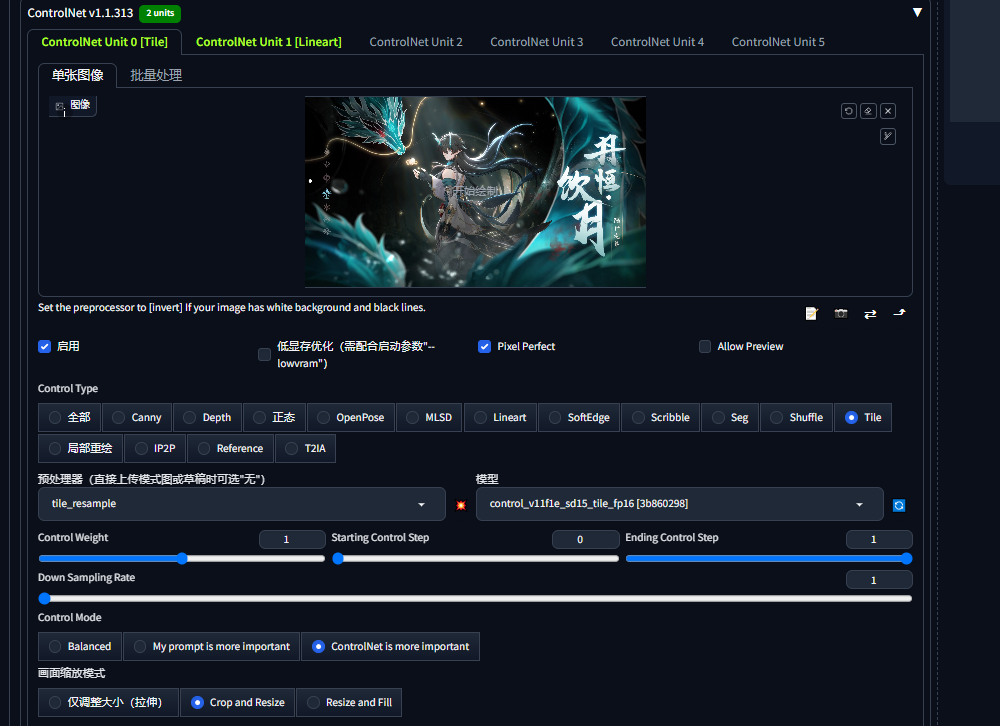

第四步 出图筛选及处理

不论是文生图,还是图生图,最终图片输出后,或多或少都会有些细节问题,即使ADetailer插件,也可能无法很好的处理手部问题,这时候就需要手动通过PS等软件进行细节处理了,当然也可以考虑多出一些图来“抽卡”。

第四步 最后放出两个作品

一个是文生图处理的,仙剑4系列

一个是图生图处理的,崩坏星穷铁道-饮月君